視訊詐騙工具暴增 不需技術就能深偽變臉及聲音

當生成式AI與深偽(Deepfake)技術結合,就是越來越多的工具被開發出來用於詐騙,不需高深技術就能偽造他人面貌、聲音,且這些工具已在黑市販售,只需幾十至幾百美金就能購得。這些利用Deepfake的詐騙手法被用於視訊會議以取信受害者,接著要求轉帳,以及用於遠距應徵工作甚至申請線上開戶與貸款等,恐影響金融秩序。企業如今除了發展自有AI模型、建構企業大腦等應用之外,也必須強化資訊驗證的機制與深偽偵測技術,杜絕詐騙風險。

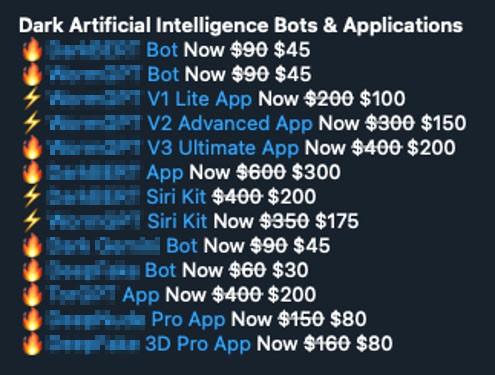

根據趨勢科技近日發表的研究報告指出,隨著生成式AI技術的迅速發展,網路犯罪地下市場的AI犯罪工具也暴增,包括過去在ChatGPT上被拒絕提供的惡意程式樣本程式碼,如今在許多被越獄成功的大語言模型(LLM)中都可輕鬆做到,並被開發成為犯罪工具在黑市兜售(如下圖)。同時,Deepfake工具也多到不勝枚舉,不管是將預錄好的影片換臉,或是支援直播影片中換臉的工具,甚至是能用來繞過金融機構KYC (Know-Your-Customer)的驗證系統,並透過偷來的身分資料存取帳戶。

這些能在影片中即時換臉的工具已被用於詐騙事件中。今年2月,CNN曾報導香港發生一起利用Deepfake技術假冒公司財務長,要求某員工轉帳2億港幣至詐騙帳戶的事件。在這起案件中,詐團為了取信該名員工還發起視訊會議,然而這場會議其他參與者,竟也是詐團偽造其公司同事面孔與聲音的騙局,因此成功讓該名員工卸下心防轉出資金。

KPMG安侯企管公司董事總經理謝昀澤曾撰文建議,金融業可透過AI建構智慧型主動防護機制,以及零信任架構,以不同方式的驗證來避免單一識別方法失效的問題。使用者也有責任提高警覺,避免在網路或社群媒體上過度揭露個資,並強化對個人行動裝置的防護認知。

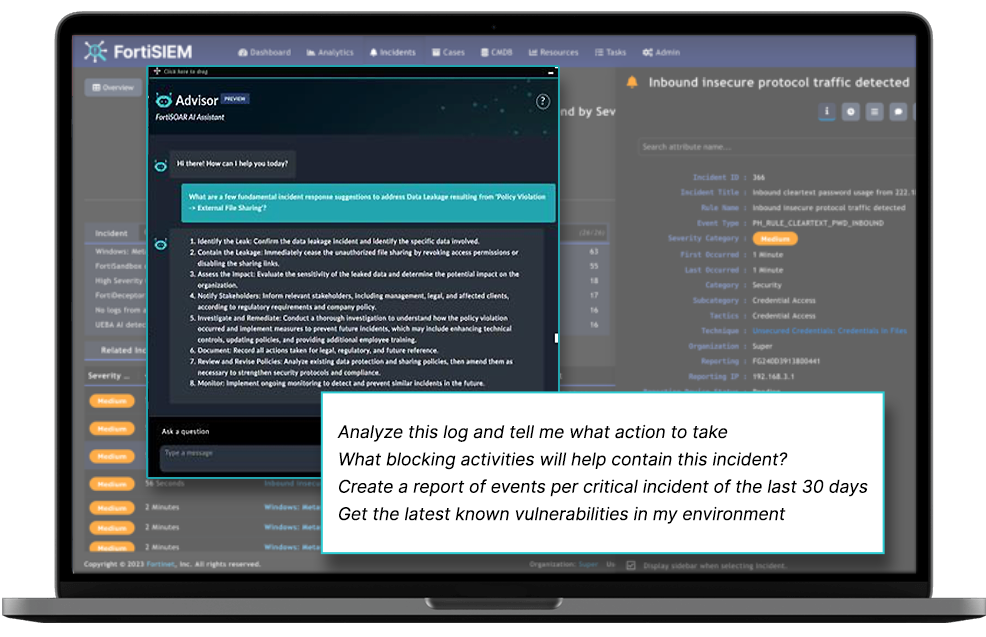

至於深偽的偵測技術,目前包括趨勢科技即將在其Trend Vision One平台上運用影像雜訊分析、色彩偵測外,也將分析使用者的行為元素來執行進一步的深偽偵測及攔截。此項功能目前也將提供給一般消費者使用,透過Trend Micro Deepfake Inspector能協助確認視訊中的對象是否使用深偽技術,確保個人隱私與資料受到保護。新創公司數位身分(Authme)先前也曾發表與台新銀行合作,推出「AI真人活體辨識技術」,可辨識是否為真人,落實KYC驗證防止詐騙。

- 首圖來源:Shutterstock